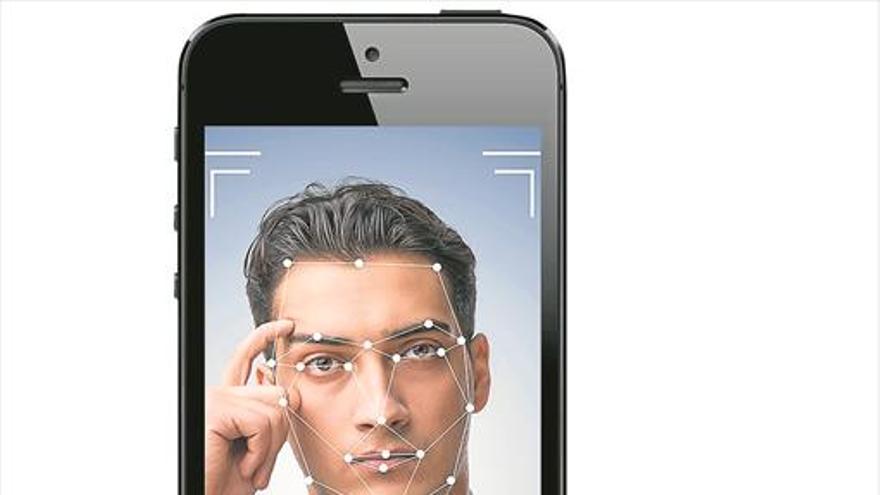

Cuando en septiembre Apple presentó el iPhone X, el modelo que para desbloquear el teléfono y autorizar compras usa la tecnología de reconocimiento facial FaceID, Edward Snowden elogió su «robusto sistema». Pero el antiguo analista de la Agencia Nacional de Seguridad de EEUU, que conoce los abusos de las autoridades aprovechando la tecnología, lanzó también la voz de alarma: «Normaliza el escaneado facial, una tecnología de la que se abusará en el futuro».

Snowden no está solo en la advertencia. Aunque el reconocimiento facial funciona desde hace años en el sector público y en el privado, el iPhone X da el gran salto a su popularización. «La gente se acostumbrará a dar su cara para identificarse y eso permitirá a los gobiernos y a las compañías convencerlos de que lo usen en otros ámbitos», asegura Jennifer Lynch, abogada especializada en privacidad y derechos civiles de la Electronic Frontier Foundation. «Estamos incorporando esta tecnología a nuestras vidas de forma innecesaria», critica Jake Laperruque, abogado en The Constitution Project, organización que trabaja por la transparencia en el gobierno federal.

Nadie niega los potenciales beneficios del reconocimiento facial en seguridad o en comercio, ni los esfuerzos de Apple por almacenar la información biométrica que recopila en el propio teléfono en vez de enviarla a través de internet. Pero, a juicio de Lynch, «la gente no es consciente de que el Gobierno está usando esta tecnología y de que los datos faciales pueden ser usados por terceros», incluyendo aplicaciones que distribuye la propia Apple. «La posibilidad de hacer fechorías con datos faciales es bastante alta -comentaba en The Washington Post Jay Stanley, un analista de la Unión Americana de Libertades Civiles-. Si no hoy, pronto; si no en Apple, en Android». Y añadía: «El peligro del reconocimiento facial es que somos objetivos donde quiera que vayamos y en todo lo que hacemos, y los usos aceptables podrían allanar el terreno para usos menos aceptables».

La ubicuidad es una de las características de la tecnología de reconocimiento facial. En muchos comercios de ropa de alta gama, por ejemplo, se escanea a los clientes para identificar a los más leales o a los famosos para darles un trato preferente. En China, donde se está adoptando a gran velocidad, se usa para actividades rutinarias como entrar en el trabajo, sacar dinero de cajeros, evitar el robo de papel de baño en aseos públicos y ofrecer en restaurantes menús personalizados tras identificar biométricamente la edad y el sexo de los clientes. Y en Rusia, una aplicación permite fotografiar a un desconocido en la calle para luego verificar si está en una red social.

Abusos de las autoridades

La propagación del sistema ha tenido lugar con un escaso debate público y una casi nula regulación. Una combinación que la abogada Lynch atribuye en EEUU «al dinero y la influencia de lobis de compañías tecnológicas y de contratistas del Gobierno» que frenan cualquier legislación, y a la insistencia de esas grandes empresas «en el argumento de que son capaces de controlarse a sí mismas», que define como «una locura».

Ya ha habido conflictos, como cuando, en Rusia, el reconocimiento facial se utilizó para señalar a participantes en una manifestación contra la corrupción o para activar una campaña de ciberacoso contra actrices porno. Y el doble problema -falta de debate y de regulación- se repite en el uso, cada vez más extensivo, de autoridades de todo el mundo. En Reino Unido y Estados Unidos, por ejemplo, la policía ya lo ha empleado en grandes citas deportivas, como la final de Champions en Cardiff entre el Real Madrid y la Juventus y en un torneo de golf en California. Y pronto la información biométrica de cualquiera que pise un aeropuerto estadounidense será registrada por un programa llamado Biometric Exit.

Un informe publicado el año pasado por el Centro sobre Privacidad y Tecnología de la Universidad de Georgetown desveló la magnitud del problema en EEUU. Aunque incumpliendo la ley no lo hizo público hasta el 2016, el FBI lanzó en el 2011 el Next Generation Identification-Interstate Photo System, una base de datos avanzada que amplió su recopilación de información biométrica mucho más allá de las huellas dactilares o el ADN de personas que han sido arrestadas. Gracias a acuerdos con Estados y con los departamentos de Estado y Seguridad Nacional, el FBI recopila fotos que ciudadanos corrientes se han tomado para el carnet de conducir o para pasaportes. Y, actualmente, 117 millones de estadounidenses, más de la mitad de los adultos del país, se hallan sin su conocimiento o consentimiento en una vasta red de datos biométricos. 52 agencias de ley y orden admiten usarla. Solo una de ellas tiene permiso legislativo para hacerlo.

«La gente inocente no debe estar en bases de datos criminales», destacó Álvaro Bedoya, director del centro y del estudio. «Al usar el reconocimiento facial para escanear las caras de carnets de conducir y de identidad de 26 estados, la policía y el FBI han metido a la mitad de los adultos de EEUU en una rueda de identificación policial masiva virtual. Nunca se había hecho con huellas o ADN. Es un territorio inexplorado y francamente peligroso».

El propio Gobierno ha reconocido los problemas del sistema. Lo hizo el año pasado un informe de la Oficina de Responsabilidad que, analizando el uso de la tecnología de reconocimiento facial por parte del FBI, descubrió que no hay responsabilidades, control ni precisión, ni se hacen pruebas sobre los fallos del software o los falsos positivos. Y una representante del organismo, Diana Maurer, declaró ante el Congreso en marzo: «No se sabe cómo de a menudo el sistema identifica errónamente al sujeto equivocado y a gente inocente podría caerle el peso de ser falsamente acusada».

Un sistema impreciso y racista

En esa vista se expuso otro problema del que alertan expertos como Joy Buolamwini, investigadora negra del MIT que demostró cómo un sistema de reconocimiento facial no leía su rostro y sí lo hacía cuando se ponía una máscara blanca. Las tecnologías de reconocimiento facial son menos precisas al identificar a personas de minorías (así como a mujeres y a jóvenes), al tiempo que el uso de la información biométrica y de las bases de datos replican sesgos discriminatorios. Se trata de una «combinación infernal» que resumió así el congresista negro Elijah Cummings: «Si eres negro, es más posible que se te someta a esta tecnología y la tecnología es más posible que se equivoque».

Es un problema que cruza fronteras, como se demostró en Londres cuando la policía la usó en una fiesta de comunidades de las Indias Occidentales, supuestamente para buscar agitadores, y solo logró una identificación correcta frente a 35 erróneas. En EEUU, aumentan advertencias como la de Lynch, la abogada de la Electronic Frontier Foundation: «Es una tecnología que impacta en minorías e inmigrantes antes que en caucásicos y se usará en poblaciones inmigrantes primero y en comunidades negras y latinas porque ya están sobrevigiladas por la policía».

Hay extrema preocupación también entre los expertos y activistas en privacidad y derechos civiles por las consecuencias que el uso policial de esta tecnología puede tener en la libertad de expresión y de reunión, especialmente ante las informaciones que apuntan a que se está usando en manifestaciones (como las protestas en Baltimore de 2015 por el asesinato de Freddie Gray) y dado el historial del FBI y otras agencias policiales de perseguir activistas o minorías (como cuando se espió a la comunidad musulmana en Nueva York tras el 11-S). «Incluso si no se abusa de la tecnología, si no hay regulaciones que limiten su uso, la gente tendrá miedo de que pueda o vaya a usarse y, solo por esa posibilidad, no participará en las actividades», alerta Laperruque.

«La gente cree que hablamos de cosas de películas de espías, de ciencia ficción, de algo del futuro, pero esto no es Minority report», advierte el abogado refiriéndose a la película basada en el relato de Philip K. Dick en la que Steven Spielberg tocó muchos de estos temas. «Aquello estaba ambientado en el 2052. Esto está pasando ya».